A IA pode estar nos deixando menos críticos.

O grande papel das universidades sempre foi ensinar o aluno a pensar. As boas instituições não eram lugares em que o professor ditava e todos apenas repetiam. Eram espaços de debate, em que o aluno aprendia a analisar, discordar e até desafiar o professor, se tivesse bons argumentos. Esse exercício formava gente capaz de tomar decisões por conta própria.

Mas isso tem mudado. Em muitas universidades, a prática crítica perdeu espaço para modelos mais superficiais, focados em repetição. E agora, com a popularização da IA, o risco é maior. Multiplicam-se alunos que usam ferramentas como ChatGPT para entregar trabalhos prontos e acreditam que, por terem acesso a respostas rápidas, já sabem mais que o professor. É a ilusão de conhecimento: informação sem reflexão.

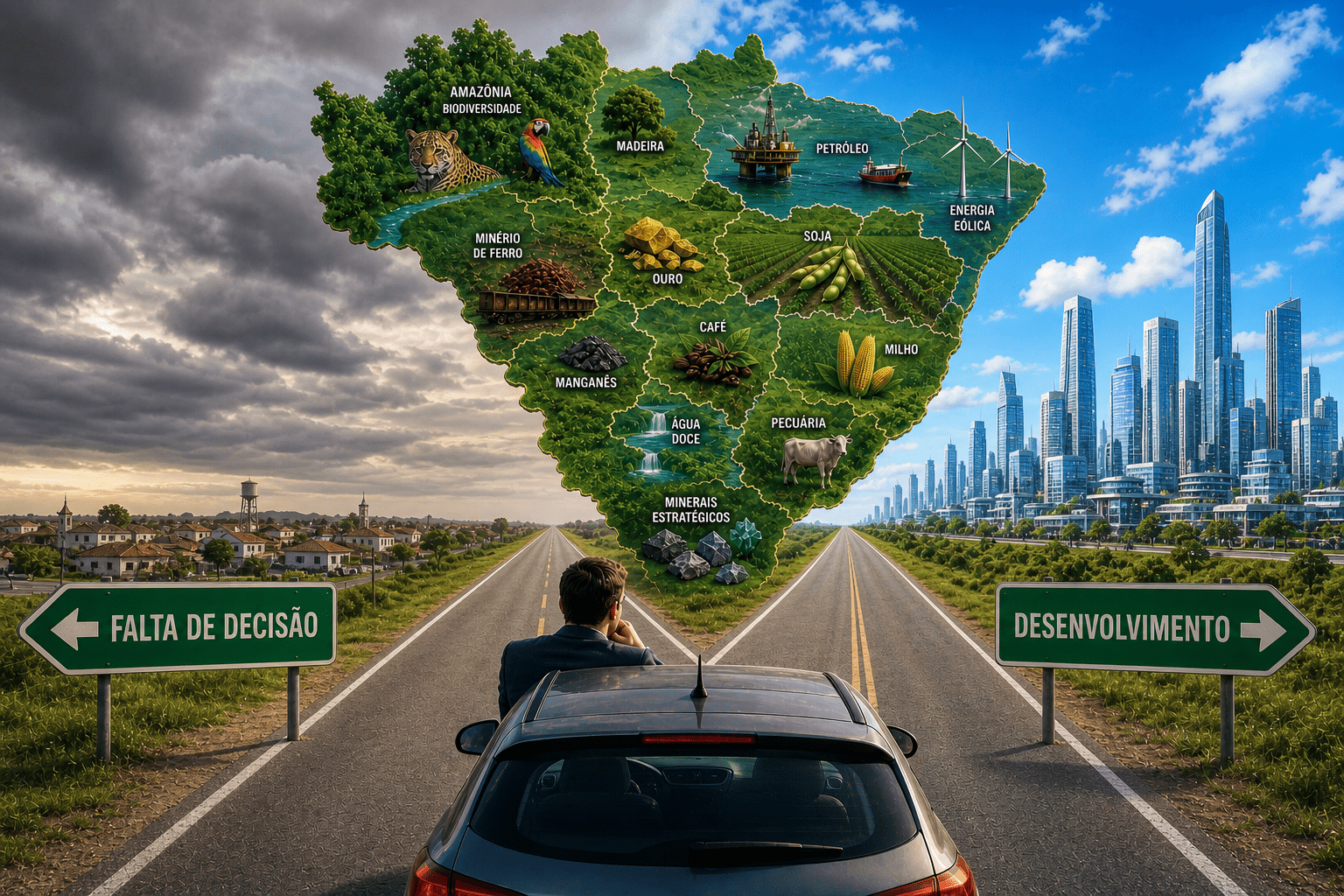

O mesmo acontece fora da sala de aula. Relatórios e apresentações cheios de gráficos e imagens gerados por IA parecem sofisticados, mas muitas vezes carecem de contexto ou dados reais. É o chamado workslop: lixo bem-apresentado. Textos ou imagens que impressionam pela forma, mas não se sustentam na substância. O perigo não está só no aluno que copia a redação pronta, mas também no profissional que aceita qualquer visual bonito como se fosse argumento válido.

A linha é tênue. A IA pode ser extensão poderosa da mente, mas se usada sem critério vira muleta.

– Os nativos digitais pedem rápido, mas muitas vezes não sabem avaliar a resposta.

– Os imigrantes digitais até formulam boas perguntas, mas não sabem quando ou como usar a ferramenta.

Se a universidade, que deveria ser o último reduto do pensamento crítico, ceder a essa sedação intelectual, formaremos profissionais que sabem buscar respostas, mas não sabem pensar com elas. E se as empresas seguirem o mesmo caminho, ficaremos presos a relatórios bonitos e decisões superficiais.

O que está em jogo é simples: professores precisam ensinar a usar IA como apoio, mas cobrar análise e autoria. Universidades precisam voltar a ser espaços de confronto de ideias. E empresas precisam tratar imagens e relatórios gerados por IA como ponto de partida, não como verdade absoluta.

Se a IA for tratada como atalho, criaremos uma geração que acessa tudo, mas entende pouco. O Brasil precisa decidir: queremos uma sociedade emancipada ou apenas usuários treinados a apertar botão?

Daniel Branco

Economista pela UNICAMP, especializado em Marketing pela UFPR

Escreve sobre Inovação, Empreendedorismo e Impacto Social

l